Microsoft a créé un nouveau modèle linguistique appelé phi-3-mini, qui est très puissant tout en étant suffisamment petit pour fonctionner sur un téléphone. Ce modèle, avec 3,8 milliards de paramètres, offre des performances équivalentes à celles de modèles beaucoup plus grands comme GPT-3.5. Le secret de son efficacité réside dans les données d'entraînement spéciales utilisées. Ils ont utilisé un mélange de données web publiques fortement filtrées et de données synthétiques créées par d'autres modèles d'IA. Cela a permis de rendre le modèle à la fois intelligent et compact.

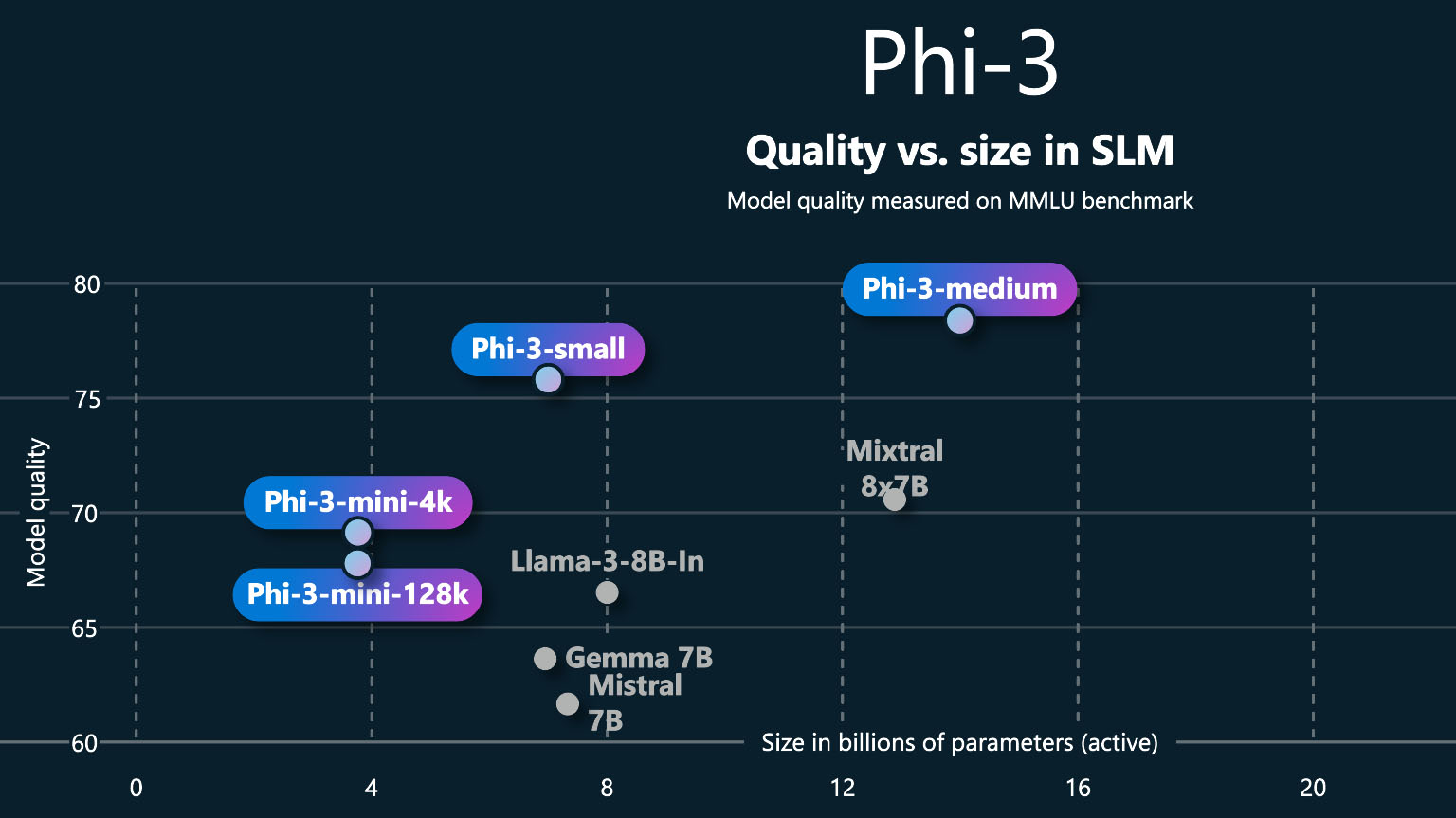

Le modèle phi-3-mini peut fonctionner directement sur un téléphone, comme un iPhone 14, sans avoir besoin d'Internet. Il peut générer des réponses rapidement, en faisant un outil pratique pour une utilisation hors ligne. L'équipe a également développé des versions plus grandes de ce modèle, comme phi-3-small avec 7 milliards de paramètres et phi-3-medium avec 14 milliards de paramètres, qui offrent de meilleures performances lors des tests.

En plus du texte, Microsoft a également introduit phi-3-vision, un modèle capable de comprendre à la fois les images et le texte. Ce modèle peut analyser des photos et générer des réponses basées sur du texte, ce qui le rend utile pour diverses applications, y compris l'éducation et la création de contenu.

La sécurité et la robustesse sont des caractéristiques clés de ces modèles. Microsoft a veillé à ce que phi-3-mini soit sûr à utiliser en l'alignant sur des principes d'IA responsables. Ils l'ont testé de manière rigoureuse pour minimiser les réponses nuisibles et améliorer ses performances dans différentes tâches.

En résumé, le phi-3-mini de Microsoft est un modèle d'IA petit mais puissant qui peut fonctionner sur des dispositifs mobiles, offrant des réponses intelligentes et rapides. Son développement montre l'importance de données d'entraînement de haute qualité dans la création de modèles d'IA efficaces et performants.